前言

参考:

- 《统计学习》—李航(蓝皮)

- 部分来自网络的内容(主要是liaohuiqiang的博客)

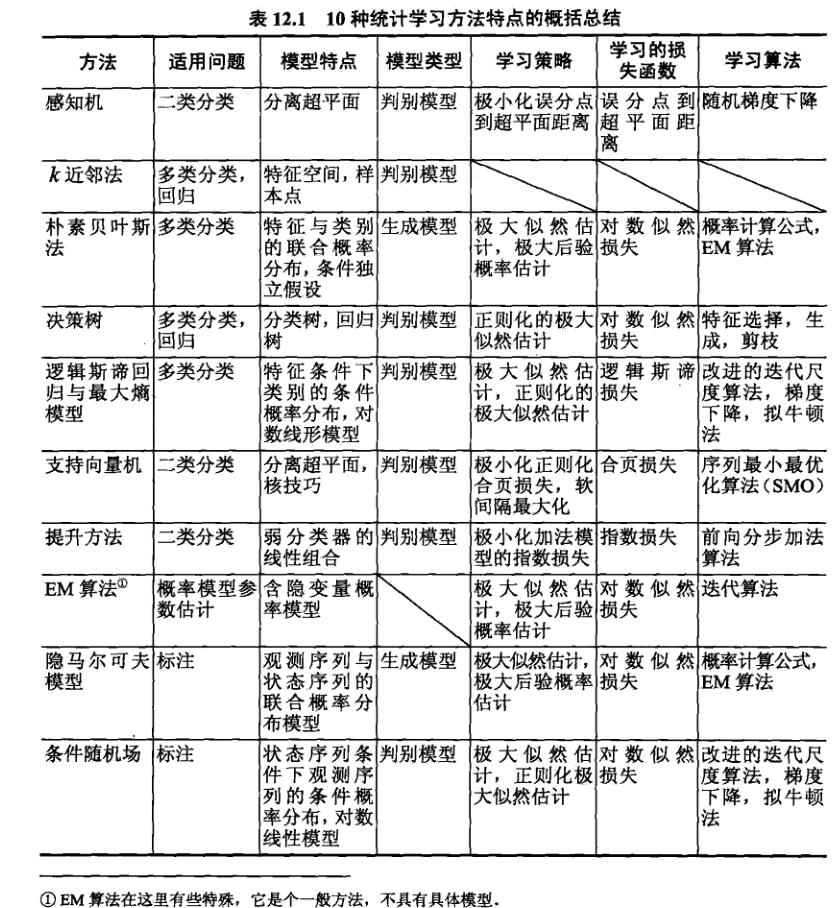

10种监督学习方法

注:笔者的笔记中并未整理最后两种

适用问题

感知机,KNN,朴素贝叶斯,决策树(排除CART回归树),逻辑斯谛回归与最大熵模型,SVM,提升方法(包括AdaBoost)是分类方法。原始的感知机,SVM以及提升方法是针对二分类的,可以将它们扩展到多类。

决策树(包括CART回归树),提升方法(包括提升树)是回归方法

EM算法是含有隐变量的概率模型的一般学习算法,可用于生成模型的非监督学习。

隐马和条件随机场是主要的标注方法。通常CRF标注准确率更高。

学习算法

统计学习的问题有了具体形式后,就成了最优化问题。有时,最优化问题比较简单,解析解存在,最优解可以由公式简单计算。但多数情况下,最优化问题没有解析解,需要数值计算或启发式的方法求解。

朴素贝叶斯和隐马的监督学习,最优解即极大似然估计值,可由概率计算公式直接计算。

感知机,逻辑斯谛回归与最大熵模型,条件随机场的学习用梯度下降法,牛顿/拟牛顿法,这些都是一般的无约束优化问题的解法。

SVM学习,可解凸二次规划的对偶问题,有SMO等方法。

决策树是基于启发式算法的典型例子。可以认为特征选择,生成,剪枝是启发式进行正则化的极大似然估计。

Boosting利用学习的模型是加法模型,损失函数是指数函数的特点,启发式地从前向后逐步学习模型,以达到逼近优化目标函数的目的。

EM算法是一种迭代的求解含因变量概率模型参数的方法,它的收敛性可以保证,但不能保证收敛到全局最优。

SVM,逻辑斯谛回归与最大熵模型,条件随机场是凸优化问题,全局最优解保证存在。而其它学习问题则不是凸优化问题。

全部评论 (0)

暂无评论,快来抢沙发吧~