前言

参考:

- 《统计学习》—李航(蓝皮)

无监督学习

无监督学习基本原理

无监督学习是从无标注的数据中学习数据的统计规律或者说内在结构的机器学习,主要包括:

- 聚类

- 降维

- 概率估计

无监督学习可以用于数据分析或者监督学习的前处理

无监督学习使用无标注数据U=\{x_1,x_2,\cdots,x_N\}学习或训练,其中x_i,i=1,2,\cdots,N,是样本(实例),由特征向量组成。无监督学习的模型是函数z=g_{\theta}(x),条件概率分布P_{\theta}(z|x),或条件概率分布P_{\theta}(x|z)。其中x\in X是输入,表示样本;z\in Z是输出,表示对样本的分析结果,可以是类别、转换、概率;\theta是参数

假设训练数据集由N个样本组成,每个样本是一个M维向量。训练数据可以由一个矩阵表示,每一行对应一个特征,每一列对应一个样本。

::: align-center

X=\begin{bmatrix}

x_{11} & \cdots & x_{1N}\\

\vdots & & \vdots\\

x_{M1} & \cdots & x_{MN}

\end{bmatrix}

:::

其中,x_{ij}是第j个向量的第i维;i=1,2,\cdots,M;j=1,2,\cdots,N

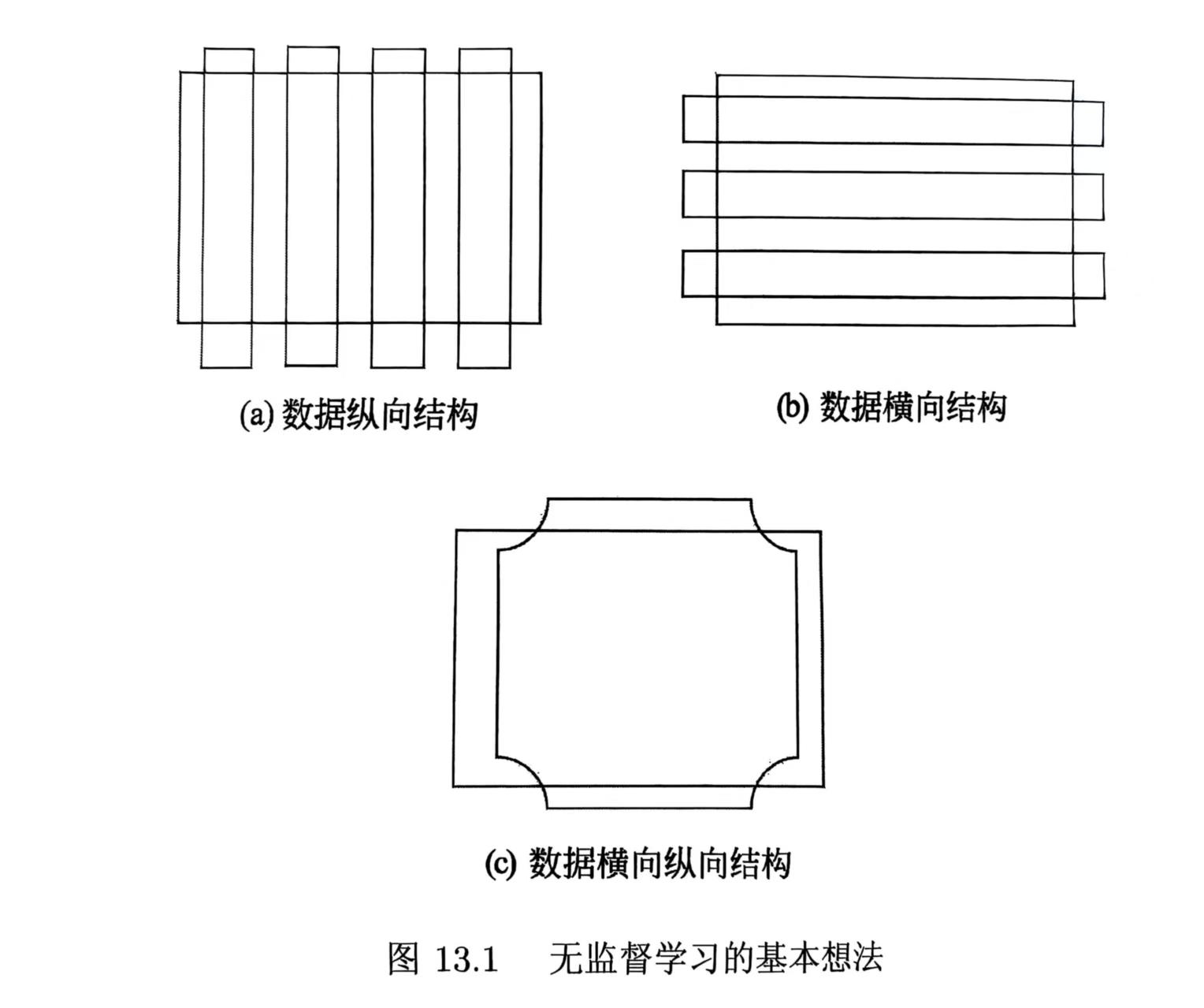

无监督学习的基本想法:对给定数据(矩阵数据)进行某种“压缩”,从而找到数据的潜在结构。

- 可以考虑发掘数据的纵向结构,把相同的样本聚到同类,即聚类

- 还可以考虑发掘数据的横向结构,把高维空间的向量转换为低维空间的向量,即对数据进行降维

- 也可以同时考虑发掘数据的纵向与横向结构,假设数据由含有隐式结构的概率模型生成得到,从数据中学习该概率模型

基本问题

聚类

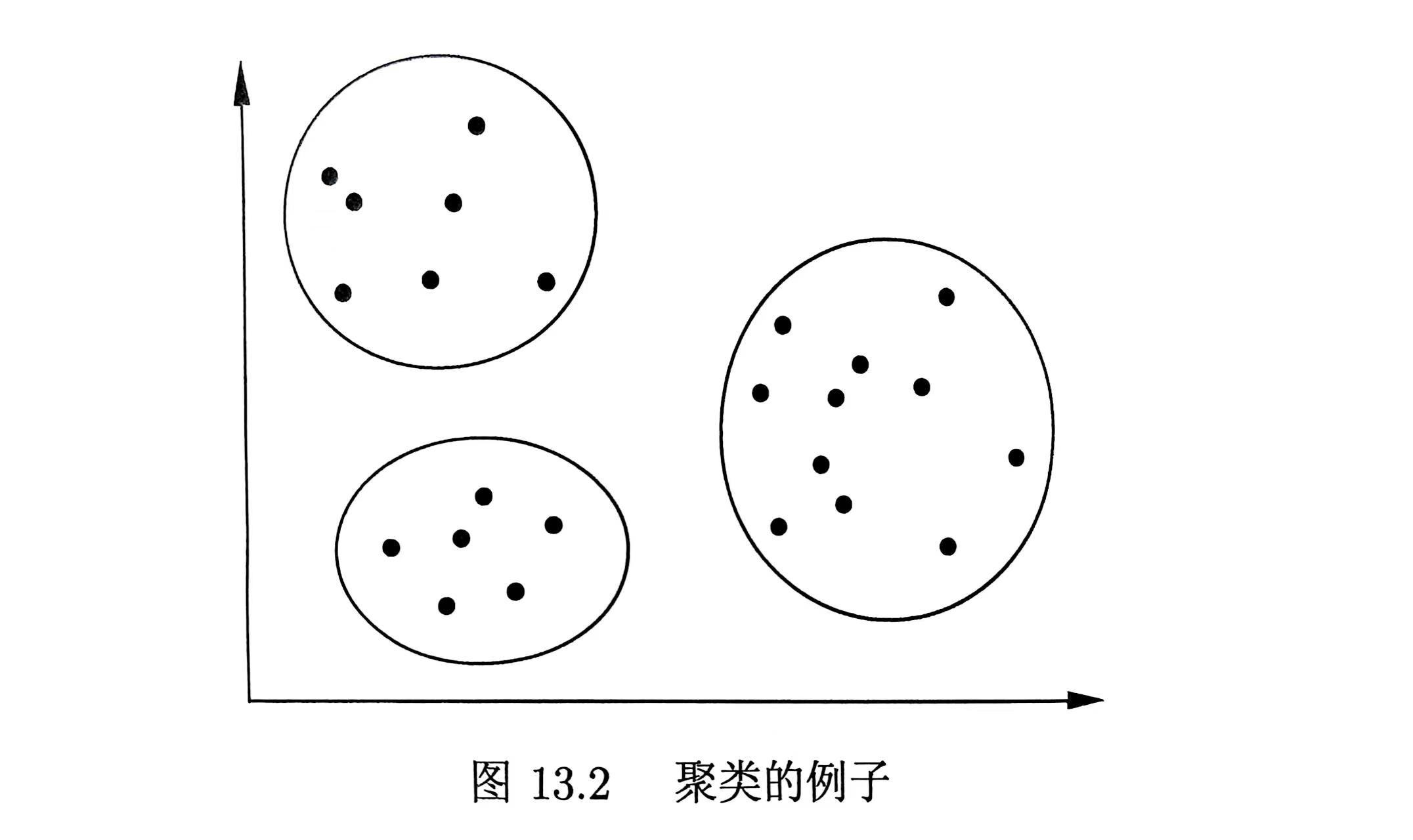

聚类(Clustering)是将样本集合中相似的样本(实例)分配到相同的类,不相似的样本分配到不同的类。聚类时,样本通常是欧式空间中的向量,类别不是事先给定,而是从数据中自动发现,但类别的个数通常是事先给定的,样本之间的相似度或距离由应用决定。

- 如果一个样本只能属于一个类,则称为硬聚类(Hard Clustering)

- 如果一个样本可以属于多个类,则称为软聚类(Soft Clustering)

假设输入空间是欧氏空间X\subseteq \mathbf{R}^d,输出空间是类别集合Z=\{12,\cdots,k\},聚类的模型是函数z=g_{\theta}(x)或者条件概率分布P_{\theta}(z|x),其中x\in X是样本的向量,z\in Z是样本的类别,\theta是参数。前者的函数是硬聚类模型,后者的条件概率分布是软聚类模型。

降维

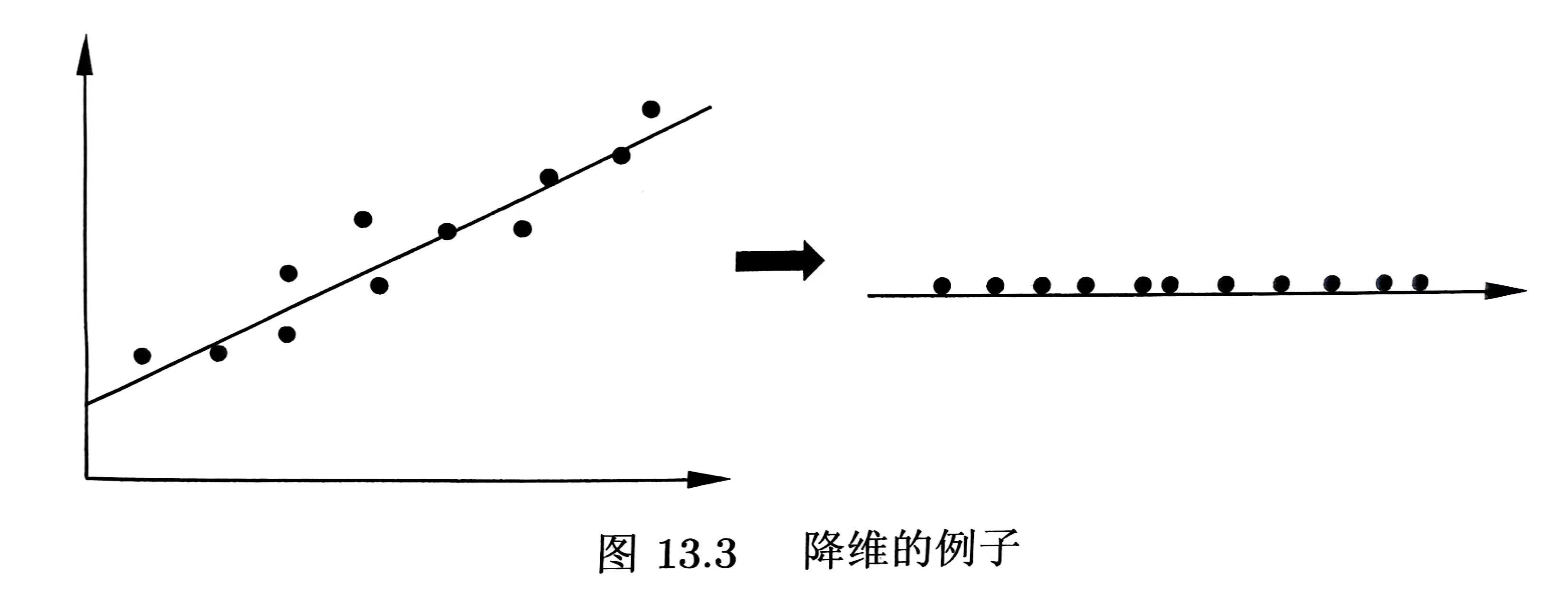

降维(Dimensionality Reduction)是将训练数据中的样本(实例)从高维空间转换到低维空间。假设样本原本存在高维空间,或者近似地存在于高维空间,通过降维则可以更好地表示样本数据的结构,即更好地表示样本之间的关系。高维空间通常是高维的欧式空间,而低维空间是低维的欧式空间或者流形(Manifold)。低维空间不是事给定,而是从数据中自动发现,其维数通常是事先给定的。从高维到低维的降维中,要保证样本中的信息熵损失最小。降维有

- 线性的降维

- 非线性的降维

假设输入空间是欧氏空间X\subseteq \mathbf{R}^d,输出空间也是欧氏空间Z\subseteq \mathbf{R}^{d'},d'\ll d,后者的维数低于前者的维数。降维的模型是函数z=g_{\theta}(x),其中x\in X是样本的高维向量,z\in Z是样本的低维向量,\theta是参数。函数可以是线性函数,也可以是非线性函数

概率模型估计

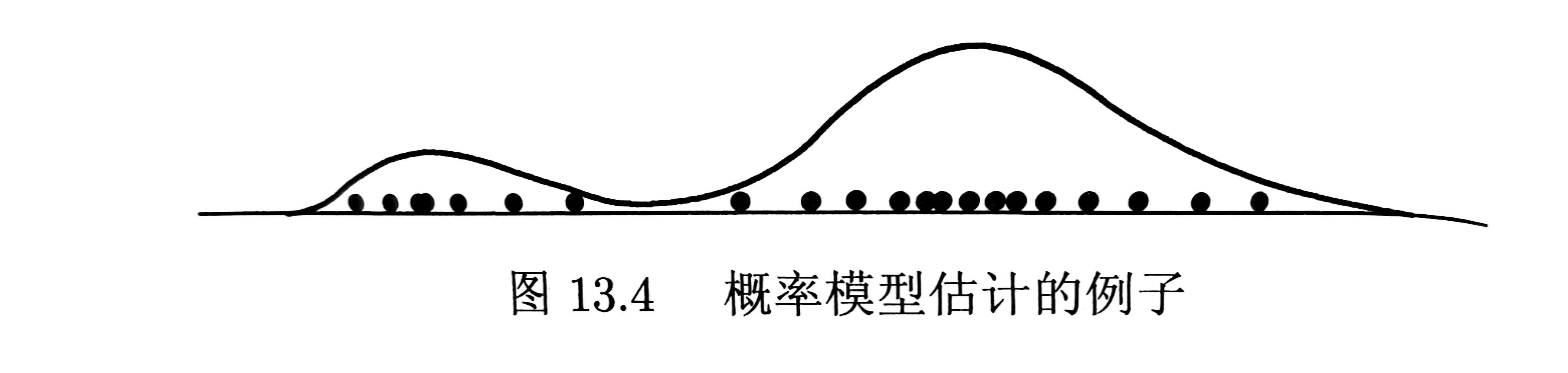

概率模型估计(Probability Model Estimation),简称概率估计,假设训练数据由一个概率模型生成,由训练数据学习概率模型的结构和参数。概率模型的结构类型,或者说概率模型的集合事先给定,而模型的具体结构与参数从数据中自动学习。学习的目标是找到最有可能生成数据的结构和参数。概率模型包括

- 混合模型

- 概率图模型

- 有向图模型

- 无向图模型

概率模型表示为条件概率分布P_{\theta}(x|z),其中随机变量x表示观测数据,可以是连续变量也可以是离散变量;随机变量z表示隐式结构,是离散变量;随机变量\theta表示模型参数,模型为混合模型时为成分的个数,为概率图模型时为图的结构

概率模型的一种特殊情况是隐式结构不存在,即P_{\theta}(x|z)=P_{\theta}(x)。这时条件概率分布估计变成概率分布估计,只要估计分布P_{\theta}(x)的参数即可。传统统计学中的概率密度估计,比如高斯分布参数估计,都属于这种情况

软聚类也可以看作是概率模型的估计问题。根据贝叶斯公式

::: align-center

P(z|x)=\frac{P(z)P(x|z)}{P(x)}\propto P(z)P(x|z)

:::

假设先验概率服从均匀分布,只需要估计条件概率分布P_{\theta}(x|z)。这样,可以通过对条件概率分布P_{\theta}(x|z)的估计进行软聚类,这里z表示类别,\theta表示参数

全部评论 (0)

暂无评论,快来抢沙发吧~